La principal amenaza a los derechos y garantías de los contribuyentes no proviene tanto de las actuaciones (humanas) de la Administración tributaria, sino de la adopción y uso de innovaciones tecnológicas y el uso (y abuso) de los datos personales.

En los últimos años, especialmente tras la crisis del COVID, la Agencia Tributaria se ha alejado físicamente del ciudadano. Ha emprendido un camino, aparentemente sin retorno, hacia un control generalizado de la población, afectando, de facto, a parte de nuestras libertades civiles y alterando sustancialmente la relación jurídica entre Administración y contribuyentes.

Un ejemplo de esta deriva se constata en la denominada Administración electrónica. Lo que inicialmente se concibió como un derecho ciudadano (relacionarse electrónicamente con la Administración) y una correlativa obligación de ésta, actualmente, en la práctica, somos los ciudadanos los obligados a adaptarnos a este cauce exclusivo de comunicación para acceder a la Administración y sometidos a un exhaustivo y agobiante suministro de datos e información.

Pues bien, en este inquietante contexto, la reciente Sentencia 1119/2025 de la Sección Tercera del Tribunal Supremo, de 11 de septiembre de 2025, abre una pequeña puerta a la esperanza. Al menos para quienes veníamos denunciando esta dinámica administrativa en medio de la indiferencia general.

La citada Sentencia constituye un hito jurisprudencial de primera magnitud al configurar el denominado principio de transparencia algorítmica (o de explicabilidad algorítmica) como un derecho de los administrados y, en particular, de los contribuyentes.

Conviene señalar que esta resolución no es estrictamente tributaria, sino que resuelve el recurso de casación interpuesto por la Fundación Ciudadana Civio contra la denegación de acceso al código fuente de la aplicación informática BOSCO, utilizada por el Ministerio para la Transición Ecológica (MITECO) para la verificación automatizada de los requisitos del bono social eléctrico.

La Sentencia, en consecuencia, establece como doctrina, en relación con los artículos 14 y 16 de la Ley 19/2013, de 9 de diciembre, de transparencia, acceso a la información pública y buen gobierno, a la luz del artículo 42 de la Carta de Derechos Fundamentales de la Unión Europea y del artículo 105.b) de la Constitución Española, que,

1.- El derecho de acceso a la información pública trasciende a su condición de principio objetivo rector de la actuación de las Administraciones públicas, para constituir un derecho constitucional ejercitable, como derecho subjetivo, frente a las Administraciones públicas, derivado de exigencias de democracia y transparencia, e inseparablemente unido al Estado democrático y de Derecho.

2.- El derecho de acceso a la información pública adquiere especial relevancia ante los riesgos que entraña el uso de las nuevas tecnologías en el ejercicio de las potestades públicas o la prestación de servicios públicos, como ocurre con el empleo de sistemas informáticos de toma de decisiones automatizadas en la actividad de las Administraciones públicas, especialmente, cuando tienen por objeto el reconocimiento de derechos sociales. En estos casos debe conllevar exigencias de transparencia de los procesos informáticos seguidos en dichas actuaciones, con el objeto de proporcionar a los ciudadanos la información necesaria para su comprensión y el conocimiento de su funcionamiento, lo que puede requerir, en ocasiones, el acceso a su código fuente, a fin de posibilitar la comprobación de la conformidad del sistema algorítmico con las previsiones normativas que debe aplicar.

En su virtud, el Alto Tribunal reconoce el derecho a acceder al código fuente de la aplicación informática BOSCO, desarrollada para que las empresas comercializadoras de referencia de energía eléctrica puedan comprobar si los solicitantes del bono social cumplen con los requisitos previstos, legal y reglamentariamente, para ser beneficiarios.

Para entender la transcendencia de esta Sentencia, conviene recordar qué son y cómo operan los algoritmos.

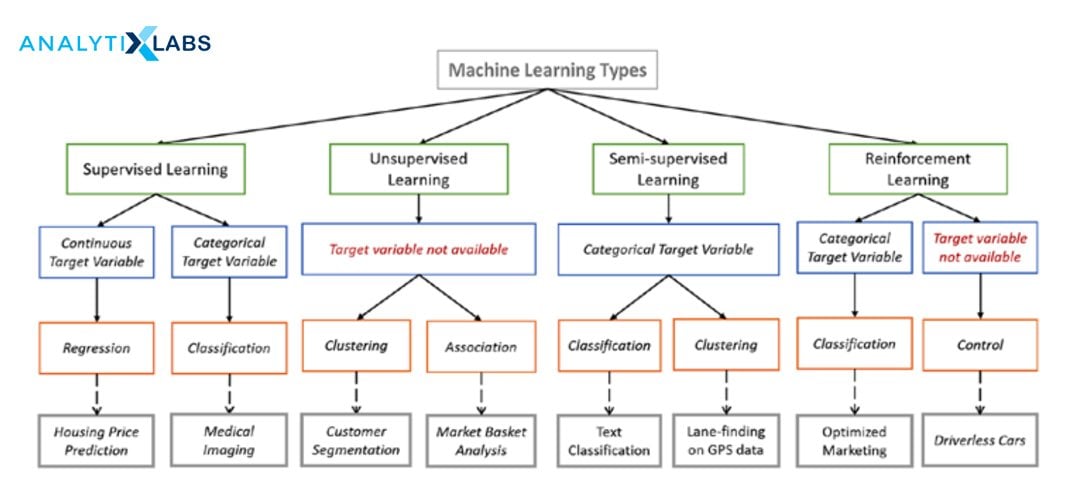

Los algoritmos son una secuencia finita y ordenada de instrucciones (un procedimiento) que permite resolver un problema o realizar una tarea. Existen desde los modelos simples (reglas simples y determinísticas, por ejemplo, si no se liquida la deuda tributaria en plazo voluntario, se emitirá providencia de apremio), modelos de machine learning (por ejemplo, la obtención de perfiles y predicciones a partir de los datos) hasta los más complejos, tipo redes neuronales profundas (Deep learning), en los que, de alguna forma, se trata de recrear (presuntamente) el funcionamiento del cerebro humano.

Así como los algoritmos más sencillos son fácilmente explicables y comprensibles, por el contrario, los modelos más complejos, responden al diseño conceptual del psicólogo conductista Skinner, los denominados algoritmos de “caja negra”, de tal forma que sólo nos permiten conocer los datos incorporados y los resultados, pero se nos oculta totalmente el proceso o secuencia realizado.

Ante esta circunstancia, el acceso al código fuente, el elemento de la controversia judicial, es la condición esencial para conocer cómo funciona y opera realmente el algoritmo, así como para poder verificar que realmente respeta el ordenamiento vigente.

Lamentablemente, la Administración se resistía a dar acceso al mismo, alegando diversos límites a la obligatoria transparencia del artículo 14.1 de la Ley 19/2013, especialmente, en cuanto a la protección de la propiedad intelectual, la seguridad pública (aumento de vulnerabilidades de la aplicación) o el eventual acceso fraudulento a datos especialmente protegidos.

Ante esta resistencia, el Tribunal no cuestiona que el código fuente sea una obra protegida (artículos 10.1.i y 95 del Real Decreto legislativo 1/1996 del Texto Refundido de la Ley de Propiedad Intelectual) ni que la Administración sea la titular de la propiedad intelectual sobre la aplicación o el sistema automatizado. Ahora bien, en la ponderación de intereses en conflicto, el Tribunal decide que prevalezca el derecho de acceso, aunque sea con la debidas cautelas y medidas que garanticen la reserva o confidencialidad, frente a los derechos de propiedad intelectual.

Pues, como señala el Alto Tribunal, “en el caso de actuaciones administrativas, el acceso al código fuente posibilita la comprobación de la conformidad del sistema algorítmico con las previsiones normativas que debe aplicar, pues la motivación – parametrizada- de la decisión administrativa que tiene lugar, reside en el diseño de los parámetros que determinan ese código fuente. Observación que adquiere singular importancia ante el hecho de que las exigencias de motivación de los actos administrativos sean predicables también de las actuaciones administrativas automatizadas, en aplicación del artículo 35 de la Ley 39/2015, de 1 de octubre, del Procedimiento Administrativo Común de las Administraciones Públicas”

Adicionalmente, frente al límite de la seguridad pública e, indirectamente, del límite del derecho a la protección de los datos personales (apartados d, g, i y k del artículo 14 de la Ley 19/2013), nuevamente, el Alto Tribunal efectúa una meticulosa ponderación de los intereses en conflicto, concluyendo que debería prevalecer la transparencia y el interés público en el acceso al código fuente frente a los límites invocados:

“Todas estas circunstancias justifican, en opinión de esta Sala, la prevalencia en este caso del interés público esgrimido por la fundación solicitante de acceder el código fuente del programa informático frente al límite del artículo 14.1.d) de la LTAIBG opuesto por la Administración recurrida, habida cuenta de que los riesgos de seguridad, además de no quedar suficientemente caracterizados, se verían en todo caso circunscritos a una operativa informática especialmente acotada (…), mientras que los intereses relativos al control de la actuación de la Administración, (…), y, por ende, el correcto funcionamiento del programa informático, sirven, en este caso, a la efectividad de relevantes bienes jurídicos como los principios de legalidad e igualdad y otros derechos constitucionales, la participación en la toma de decisiones, el fortalecimiento de la democracia y la generación de confianza en las instituciones públicas.

Como consecuencia de todo lo hasta aquí expuesto, considera esta Sala que la transparencia exigible en el funcionamiento de la aplicación telemática BOSCO, con evidente y relevante impacto en los derechos sociales de los ciudadanos, no queda garantizada con la mera explicación funcional sobre la misma, ofrecida por la Administración titular de la aplicación, sino que exige el acceso a su algoritmo, pues de otro modo no resultaría posible comprobar con exactitud y detalle dicho funcionamiento y, por ende, la sujeción de las ordenes o instrucciones en lenguaje informático que contiene a las previsiones legales y reglamentarias sobre los requisitos necesarios para la obtención del bono social.”

Además, esta transparencia es aún más exigible dado que la aplicación permite la toma de decisiones automatizadas, con especial trascendencia en los derechos de los ciudadanos, en la medida que determinan o condicionan el reconocimiento o denegación de derechos y prestaciones públicas. Entra en juego, además, el denominado requisito de “explicabilidad” (artículos 15.1.h y 22 del Reglamento UE 2016/679, de 27 de abril de 2016, de protección de datos personales), en virtud del cual, los ciudadanos debemos conocer la lógica aplicada en el tratamiento de nuestros datos. Obviamente, este requisito entronca con el deber fundamental de motivación de los actos administrativos, por lo que, no cabe admitir opacidades que condicionen los derechos constitucionales de los ciudadanos y se automatice la relación jurídica entre Administración y administrados.

En definitiva, dar acceso al código fuente para entender cómo se toman las decisiones no sólo es una condición inexcusable para preservar la rendición de cuentas y la fiscalización de las decisiones de los poderes públicos, sino una garantía frente a la arbitrariedad y los sesgos en el diseño y la arquitectura de las decisiones.

A los efectos prácticos, el Tribunal sienta el criterio de que, a mayor automatización, mayor debería ser el grado de transparencia. Y cuanto más se aleja la intervención humana (de los funcionarios competentes) y más prevalezca el algoritmo, mayor debería ser la exigencia de la información a proporcionar.

Aplicación de la doctrina BOSCO a la Administración Tributaria.

Aunque la Sentencia BOSCO no se refiere al ámbito tributario, su doctrina resulta plenamente aplicable, ya que los mismos principios de transparencia y explicabilidad son esenciales cuando las decisiones administrativas afectan directamente a derechos y obligaciones fiscales.

Conviene recordar que las distintas Administraciones tributarias, especialmente, la Agencia Estatal de Administración Tributaria (AEAT), utilizan extensamente sistemas algorítmicos y de inteligencia artificial como, por ejemplo, en:

- Información y asistencia.

- Tratamiento masivo de los datos proporcionados por los contribuyentes.

- Selección de contribuyentes para comprobaciones tributarias.

- Planes de control tributario.

- Valoración de riesgos fiscales.

- Elaboración de borradores de declaraciones.

- Análisis de operaciones y detección de fraude.

- Comprobaciones automatizadas de requisitos para incentivos fiscales o regímenes especiales.

La propia AEAT reconoce en su Estrategia de Inteligencia Artificial (27 de mayo de 2024) el uso, entre otros, de machine learning, big data y técnicas avanzadas en sus procesos, sin embargo, defiende la opacidad acerca del uso de IA y se siente amparada normativamente para mantener la reserva, negando información y motivación a los ciudadanos.

En particular, entre otros, la Administración tributaria se parapeta tras el artículo 95 de la Ley 58/2003 y los límites al derecho de acceso regulados en el artículo 14 de la Ley 19/2013 de Transparencia, Acceso a la Información Pública y Buen Gobierno (LTAIBG) (sobre todo, los relativos a la seguridad pública y las funciones administrativas de vigilancia, inspección y control). Aparte, en el Reglamento (UE) 2024/1689, de 13 de junio de 2024, sobre Inteligencia Artificial se excluye de forma expresa de la consideración de sistemas de alto riesgo a los empleados por las Administraciones tributarias (artículo 6 y Anexo III), si bien ello no les excusa de cumplir con los requisitos de transparencia y explicabilidad (artículo 13), supervisión humana (artículo 14) o la evaluación del impacto en los derechos fundamentales (artículo 27), entre otras obligaciones.

Sin embargo, el Tribunal Supremo abre una mínima brecha en esa oscuridad y arroja algo de luz, a la vez que cuestiona la dinámica de automatizar la relación tributaria.

A continuación, desearía apuntar algunas de las principales cuestiones que podrían verse afectadas a raíz de la Sentencia BOSCO:

- Diseño Cerrado y Falta de Transparencia: Pese a la adopción de un enfoque formalmente centrado en el ser humano (‘human centric‘), la AEAT desarrolla e implementa sus sistemas de IA en un entorno cerrado, sin mecanismos de transparencia o participación externa que permitan una auditoría independiente. Esta falta de escrutinio público incrementa el riesgo de que se perpetúen sesgos en el diseño y aplicación de los algoritmos. Asimismo, la efectividad del control humano (‘human in the loop‘) resulta cuestionable si se ejerce exclusivamente por personal interno, sin permitir el acceso de terceros al código fuente para su verificación. De lo contrario, estas salvaguardas podrían interpretarse como una justificación meramente formal que no satisface las exigencias de un control real y efectivo.

Quizás la Sentencia no pueda permitirnos el acceso pleno a todos los sistemas de IA y asimilados que aplique la AEAT, sin embargo, debería permitirnos un mínimo acceso para conocer que la secuenciación parametrizada para obtener resultados sea acorde con la normativa tributaria vigente.

La Sentencia es categórica al establecer que el código fuente (y, por extensión, la lógica del algoritmo) es información pública sujeta a la Ley de Transparencia. Esto desmonta el principal escudo de la Administración. Ya no puede argumentar que la lógica de sus sistemas es un secreto interno.

El carácter absoluto de los límites ha desaparecido. Así pues, si antes de la citada Sentencia, a la Administración le bastaba con hacer referencia al artículo 14.1.g) de la Ley 19/2013 para negar el acceso, a partir de ahora, deberá entrar en el juego de la ponderación de intereses y deberá explicar y exponer de forma suficiente las razones para mantener la opacidad.

- Actuaciones Automatizadas sin la debida motivación completa. Actualmente, las Administraciones tributarias han ido desarrollando sistemas y aplicaciones que les permite automatizar las decisiones (y actos administrativos), reduciendo a la mínima expresión la participación humana.

El ejemplo paradigmático son los requerimientos masivos de información y datos que se inician con la fórmula «se han detectado ciertas incidencias» o que los datos declarados «no se corresponden con los datos de que dispone la Agencia Tributaria«.

En mi opinión estos actos deberían ser cuestionados pues carecen de la debida motivación y lesionan los derechos y libertades de los contribuyentes, trasladando una «presunción de culpabilidad» sin conocer de forma transparente qué datos concretos han generado la discrepancia, el origen o fuente de los mismos, así como si se han tratado o validado. En este sentido, sostengo (y aplico) que no debería darse respuesta sin tener acceso previo a los datos e información que sustenta el requerimiento o la comprobación administrativa. Así, frente a un requerimiento genérico basado en «discrepancias», el contribuyente, amparado por esta doctrina, debería solicitar acceso al algoritmo o, como mínimo, a las reglas lógicas y los datos específicos que han llevado a esa conclusión. Entre otras, esto se alinea con la exigencia del artículo 132 de la Ley 58/2003 General Tributaria, que obliga a la Administración a comunicar la «discrepancia observada».

En aras a respetar los principios de transparencia y buena administración, entre otros, no debería admitirse que dichos requerimientos automatizados se califiquen como actos de “mero trámite” y no se les exija una adecuada motivación, máxime cuando estos actos administrativos suponen el inicio formal de un procedimiento tributario.

Precisamente, en la Sentencia se afirma que cuando las Administraciones Públicas hacen uso de sistemas informáticos de toma de decisiones automatizadas en el ejercicio de las potestades públicas, con afectación de los derechos de los ciudadanos, el acceso a su código fuente es uno de los mecanismos a través de los cuales se garantiza la transparencia algorítmica que demanda el pleno ejercicio del derecho a la información pública. Además, la normativa de protección de datos impone determinadas exigencias de información y transparencia sobre la lógica empleada cuando se realicen tratamientos de datos personales que impliquen la adopción de decisiones individuales automatizadas, esto es, decisiones basadas únicamente en el tratamiento automatizado, incluida la elaboración de perfiles, que produzcan efectos jurídicos en el interesado o le afecte significativamente.

Por tanto, en la medida que los actos administrativos notificados al contribuyente sean el resultado de actuaciones o decisiones automatizadas, la doctrina BOSCO refuerza la idea de que la motivación (artículo 35 de la Ley 39/2015) no puede limitarse a una fórmula genérica, sino que debería reflejar las razones efectivas (humanas y/o algorítmicas) que sustentan la decisión administrativa.

- El algoritmo como «caja negra» inexpugnable y al margen del procedimiento. De hecho, el núcleo del problema es la sustitución del actuario humano (cuyo criterio era conocible y discutible) por un oscuro algoritmo que se mantiene al margen.

El progresivo desarrollo e implantación de la administración electrónica y el uso creciente de aplicaciones informáticas, con evidente trascendencia en los derechos de los contribuyentes, al determinar o condicionar la relación tributaria, comporta que la configuración y el empleo de los algoritmos adquieran una relevancia decisiva y exijan un mínimo de transparencia, adaptada según el nivel de complejidad del propio algoritmo.

Recordemos que, en el artículo 22 del Reglamento (UE) 2016/679 del Parlamento Europeo y del Consejo, de 27 de abril de 2016 (RGDP), expresamente se indica que, “todo interesado tendrá derecho a no ser objeto de una decisión basada únicamente en el tratamiento automatizado, incluida la elaboración de perfiles, que produzca efectos jurídicos en él o le afecte significativamente de modo similar.”

Y, aunque la normativa acepta este tratamiento automatizado (artículo 22.2.b del RGPD y articulo 41 de la Ley 40/2015), entre otros, en aras del control y persecución del fraude fiscal, expresamente se recuerda que debe estar sujeto a las garantías apropiadas, entre las cuales figuran la información específica al interesado y el derecho a obtener intervención humana, a expresar su punto de vista, a recibir una explicación de la decisión tomada y, en su caso, a impugnar la decisión.

La Administración mantiene la opacidad sobre el algoritmo y la arquitectura de decisiones y, se ampara en que, en última instancia, hay un humano (el funcionario competente de turno) que valida o hace suya la decisión automatizada. Ahora bien, ¿cómo puede la AEAT decir que motiva adecuadamente una decisión cuyo proceso interno no puede explicar completamente, entre otras razones, porque se lo oculta al propio funcionario que valida el resultado? En otras palabras, la motivación es ilusoria si el funcionario no conoce ni puede explicar el cálculo interno realizado por la IA, lo que constituiría una vulneración del deber de motivación y del derecho del contribuyente a conocer las razones de la decisión.

En cualquier caso, aún admitiendo que un humano «haga suyo» el resultado de un algoritmo, asumirá la obligación de explicarlo de forma íntegra y completa, pues el contribuyente tiene derecho a conocer el proceso lógico subyacente. En caso contrario, estaríamos ante una clara vulneración del deber de motivación, así como del derecho fundamental a una tutela judicial efectiva y la interdicción de la arbitrariedad.

- La dudosa legalidad del artículo 170.7 del Real Decreto 1065/2007 del Reglamento General de las actuaciones y procedimientos de gestión e inspección tributaria según el cual se establece que «los medios informáticos de tratamiento de información y los demás sistemas de selección de los obligados tributarios que vayan a ser objeto de actuaciones inspectoras tendrán carácter reservado«.

En mi opinión, esta restricción al derecho de acceso a la información sobre los criterios de decisión entraría en abierta contradicción con la doctrina del Tribunal Supremo. De hecho, a la luz de la Sentencia, cualquier contribuyente debería tener derecho a conocer los criterios objetivos (datos, información, perfil, riesgos, etc.) que justifican la apertura de cualquier tipo de procedimiento de comprobación e investigación tributaria, entre otras razones, para evitar dudas de actuaciones arbitrarias o discriminatorias.

Esta transparencia es necesaria para garantizar el derecho de defensa y a la tutela judicial efectiva, aparte de respetar el principio de interdicción de la arbitrariedad.

Precisamente, el Alto Tribunal recuerda que el principio de buena administración conduce a una interpretación amplia y expansiva de este derecho constitucional, que conlleva una interpretación restrictiva de los límites oponibles al acceso a la información pública. La Sentencia BOSCO, se une a la doctrina jurisprudencial, entre otras, las Sentencias de 23 de diciembre de 2022 (rec. 1763/2022) y 30 de abril de 2025 (rec. 1100/2022), en cuya virtud, a partir de los artículos 9.3, 103 y 106 de la CE y el artículo 41 de la Carta de los Derechos Fundamentales de la UE, se enfatiza que el principio de buena administración no es una mera fórmula vacía de contenido, “sino que se impone a las Administraciones públicas de suerte que a dichos derechos sigue un correlativo elenco de deberes a estas exigibles, entre los que se encuentran, desde luego, la transparencia y el acceso a la información pública”.

Como profesionales, ante cualquier procedimiento administrativos (tributario) parcial o totalmente automatizado, en aras de una debida motivación, deberíamos solicitar formalmente, no sólo el acceso de los datos personales, así como la información que tiene relevancia en el procedimiento en curso, sino también, el acceso a la lógica del algoritmo.

En definitiva, la Sentencia BOSCO permite ampliar el debate y el conocimiento sobre el uso y la aplicación de las innovaciones tecnológicas y la implantación de la automatización por la Administración tributaria.

Es cierto que existen usos y aplicaciones que benefician al conjunto, gracias a la mejora en la eficiencia y eficacia administrativa y facilitan la accesibilidad de los ciudadanos (como, por ejemplo, la disponibilidad a las declaraciones presentadas o la obtención de certificados electrónicos).

Sin embargo, también existen usos y aplicaciones que están alejando, en el sentido pleno, al ciudadano de la Administración y están transformando el equilibrio y la debida relación jurídica, convirtiendo al contribuyente meramente en una fuente de datos, sometido a un control permanente por algoritmos opacos y con unos derechos y libertades limitados por la tecnología.

La Sentencia BOSCO debería inspirar una revisión profunda de los sistemas de inteligencia artificial empleados por las administraciones, para que la tecnología sea un instrumento al servicio de la legalidad y no un velo que la oculte.

La pregunta, Emilio, es por qué la resistencia numantina de la Administración a transparentar el código fuente de los algoritmos sobre los que operan sus aplicaciones